AI エージェントは、目を引くデモから実際にあなたの代わりに動作できるツールへと急速に進化しており、OpenClaw はその最新の注目を集める名前の一つです。開発者のオーストリア人 Peter Steinberger は、開発の段階によって Clawdbot や Moltbot といった別名を使ってきました。

ソフトウェアを代行操作するハンズオフのパーソナルアシスタントとして宣伝されていますが、アクセス権やセキュリティに関して重要な疑問も生じます。

- AI エージェントは会話だけでなく実際に行動できる AI システムです。

- OpenClaw のようなツールは、セルフホスト型の AI エージェントがいかに強力になり得るかを示しています。

- このような能力は、エージェントが信頼できない入力を処理する際に新たなセキュリティリスクをもたらします。

- プロンプトインジェクションは、チャットボット以上に AI エージェントにとって重要な脅威です。

- 持続的なメモリはミスを増幅させ、攻撃を長引かせる可能性があります。

- AI エージェントは強力ですが、ほとんどの消費者にとって安全な既定値とは言えません。

OpenClaw の話題性の理由は何ですか?

OpenClaw が注目されるのは、質問に答えるだけの AI から、実際のシステム上でタスクを実行したりソフトウェアを使ったりできる AI へと変化していることを示しているためです。この潜在的なセキュリティ問題により、セキュリティ領域での議論が増えています。開発者やパワーユーザーにとって OpenClaw の魅力はどこにあるのでしょうか。

OpenClaw が際立っているのは、テキストや提案を生成するだけでなく実際に行動を起こせる点です。ユーザーに「何をすべきか」伝える代わりに、自ら操作を行います。アプリの起動、メッセージ送信、ファイル移動、コマンド実行、システムとの直接的なやり取りなどを、あなたに代わって行える技術です。

このレベルの自動化が関心を集めています。開発者やパワーユーザーはシステムレベルの制御を、反復作業の削減やワークフローの自動化に役立てようと考えます。「助言するだけでなく“実際に仕事をこなす”エージェント」という発想は強力です。

こうした実行力の約束が、OpenClaw をニッチなプロジェクトから幅広い議論の対象へと押し上げました。

OpenClaw を超えて重要な理由

OpenClaw は、単に応答や助言を返すだけでなく実際に行動する AI エージェントへの大きな変化を可視化する例を提供します。

この種の技術が広がれば、悪用の可能性についての議論は避けられません。OpenClaw が示すのは、AI の向かう方向性であり、それは単一プロジェクトにとどまらず、これらのエージェントをどのように制御すべきかという継続的な議論の土台を作ります。信頼できるでしょうか?

AI エージェントとは何で、他の AI ツールと何が違うのですか?

AI エージェントは、質問に対してテキストや音声で答えるだけのシステムではありません。目標達成のためにステップを計画し、自ら行動を実行できます。助言で止まらず、次に何をするかを決めて実行するのです。

エージェントは状況を観察して行動できます。これは、プロンプトに応答して次の指示を待つ従来型の多くの AI ツールとは異なります。初期の例としては Manus(現在は Meta の所有)のようなタスク実行型エージェントがあり、チャットの域を超えて実際に動作することを示しています。データ分析を行ったり、問題解決のためにコードを書いたりすることを、明示的に指示されなくても行える場合があります。人間の入力はより少なくて済みます。

OpenClaw はこの「行動可能な AI」という考え方をさらに直接的かつ強力に適用したものです。

OpenClaw は典型的な AI エージェントですか、それともより進んだ存在ですか?

OpenClaw は AI エージェントの範疇に入りますが、多くの人が馴染みのあるツールより強力な実装を提供します。

この AI ツールは、継続的な入力を必要とせずにタスクを計画し、行動できます。OpenClaw は単なる API 呼び出しや限定的なツール連携だけでなく、ソフトウェアや OS と直接やり取りできるため、利用価値が高く、他と一線を画します。同時にリスクも増し、セキュリティの重要性が高まります。

セルフホスト型 AI エージェントが特別な理由

セルフホスト型の AI エージェントは、リモートサービス上で動作するのではなく、ユーザー自身のシステム上でローカルに実行されます。これにより、設定や挙動に対するユーザー側のコントロールが増しますが、責任も移ります。

エージェントがローカルアクセス権を持つ場合、セキュリティは設定方法、権限の与え方、監視方法に依存します。より大きな制御は同時により大きなリスクを伴います。

最近のプロジェクトは「セルフホスト」エージェントの考え方を変えつつあります。たとえば Moltbot(旧 Clawdbot)は、Cloudflare のオープンソース Moltworker を使って実行できるようになりました。これにより専用のローカル機器が不要になり、管理されたプラットフォーム上でエージェントを動かすことが可能になります。

これにより参入障壁やセットアップの手間は下がりますが、コントロールの所在も移動します。エージェントがクラウドインフラ上で動作する場合、セキュリティはエージェント自体だけでなく、アクセス制御やプラットフォーム全体でのデータ・権限の扱いに依存します。

例えば、ユーザーはエージェントをメールの閲覧だけに接続したつもりでも、クラウド設定がデフォルトで送信権限を与えていれば、メール送信も可能になっている場合があります。

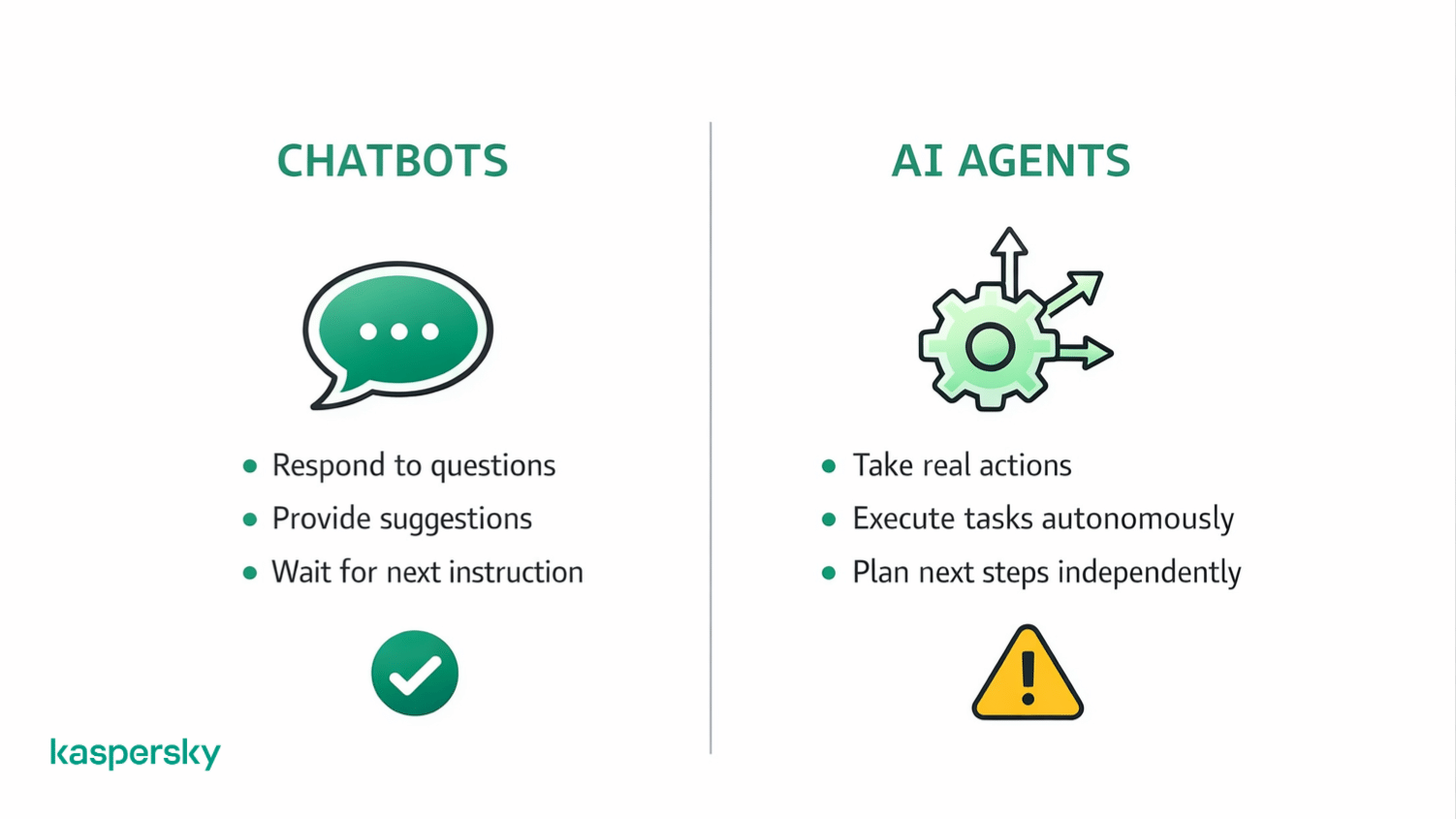

ChatGPT のようなチャットボットと AI エージェントはどう違うのか?

チャットボット(例:ChatGPT)は「応答」し、AI エージェントは「行動」します。

チャットボットは提案や説明を提供できますが、エージェントはプログラムを開いたりワークフローを実行したりできます。

例として、一部の人は OpenClaw を使って取引を自動化した ことがあります。彼らはルールを作成し、単に助言を求めるのではなく(これは ChatGPT でも可能です)実際に取引を実行させるように AI に指示しました。

なぜ AI エージェントは新たなセキュリティリスクをもたらすのか?

前述の通り、AI エージェントは助言を与えるだけでなく行動を起こします。これにはファイル、アプリケーション、システム機能へのアクセスが伴うことが多いです。

OpenClaw に与えられるシステムアクセスと自律性は、影響とリスクの両方を変えます。OpenClaw はソフトウェアと連携したり、メール送信やフォーム入力といった操作を監視なしに実行する許可を求める可能性があり、それが不確定要素になります。

ミスや操作による結果は現実的な影響を生み得ます。リスクは単にエージェントに何をさせるかだけでなく、タスク実行中にエージェントがどのように入力を解釈するかにもあります。

信頼できない入力が核心的な問題である理由

AI エージェントは、次に何をするかを判断するために大量の外部コンテンツ(ウェブページや文書など)を取り込みます。そのコンテンツが常に信頼できるとは限りません。

指示は一見直接的である必要はありません。タスク実行中にエージェントが読むテキストやデータに紛れ込む形で隠されていることがあります。攻撃者はエージェントと直接やり取りしなくても、エージェントの挙動に影響を与えられるのです。

この問題はプロンプトインジェクションへの明確な道筋をつくります。信頼できない入力が、エージェントを本来意図しない行動へと誘導する手段になります。

強力な AI ツールにはより強固な保護が必要です

AI エージェントはファイルやメール、システム機能にアクセスできます。Kaspersky Premium は不審な動作の検知、悪意あるスクリプトのブロック、実際のサイバー脅威からの保護を支援します。

無料で Premium を試すAI エージェントにおけるプロンプトインジェクションとは何か?

プロンプトインジェクションは、信頼できないコンテンツを与えてエージェントの挙動を変える手法です。

問題はコードの技術的な欠陥だけではありません。エージェントが外部からの入力をメッセージやコメントのように扱い、それを指示と解釈してしまう点が問題なのです。そうなると、エージェントは本来意図していない行動に導かれます。

実際のシナリオでプロンプトインジェクションがどのように働くか

プロンプトインジェクションは直接的な場合と間接的な場合があります。

- 直接的 – 攻撃者がエージェントが読むコンテンツに意図的に指示を含める場合。

- 間接的 – エージェントが通常のタスク中に処理するウェブサイトやメッセージから、隠れたまたは予期しない指示を拾ってしまう場合。

重要なのは挙動です。エージェントは、たとえそれが信頼できない情報源から来たとしても、自分がガイダンスだと解釈したものに従ってしまう可能性があります。これを起こすためにソフトウェアのバグは必ずしも必要ありません。

なぜプロンプトインジェクションはチャットボットよりエージェントにとって危険か

挿入された指示は通常、チャットボットでは応答や助言に影響を与えます。AI エージェントの場合、それが実際の行動に直結する可能性があります。

エージェントがファイルやシステム制御にアクセスできる場合、操作された指示は現実世界の変化を招くことがあります。チャットボットでテキスト出力を変えるのと同じ手法が、エージェントでは意図しない操作を引き起こすのです。だからこそ、プロンプトインジェクションはエージェントにとってより大きなリスクになります。

AI エージェントにおける持続的メモリとは何か?

持続的メモリは、エージェントが時間をまたいで情報を保持できる仕組みです。毎回ゼロから始めるのではなく、過去の入力を将来の意思決定に生かします。

持続的メモリが AI エージェントにもたらす意味

エージェントはセッションを跨いでコンテキストや指示を保存し、好ましい“振る舞い”を育てることができます。これにより、エージェントは以前学んだことや実行したことを覚えているため、より効率的に動作できます。

同時に、以前の入力が後の挙動に影響を及ぼす可能性もあります。以前のタスクで取り込んだ指示や前提が、ユーザーが気づかないうちに別の状況でも作用するかもしれません。

なぜ持続的メモリがセキュリティリスクを高めるのか

持続的メモリは遅発的な影響を生じさせる可能性があります。悪意ある指示が即座に問題を起こさなくても、条件が揃ったときに再び表出することがあります。

これによりクリーンアップが難しくなります。蓄積された振る舞いはタスクを跨いで繰り返されることがあり、エージェントを完全に復元するにはメモリの消去や設定の再構築が必要になることが多いです。

エージェントが誤設定されたり露出した場合に何が起きるか?

AI エージェントは、所有者の意図しない方法でアクセスされたり影響を受けたりする可能性があり、役立つツールがセキュリティ上のリスクに変わることがあります。

これは事故や誤解によって起こることがありますし、第三者がエージェントを操作しようとする場合にも起き得ます。

エージェントが意図せず露出する仕組み

露出はしばしば単純なミスによって発生します。弱い認証や過度に広い権限といった些細なことが、エージェントを本来の環境の外部から到達可能にしてしまうことがあります。

エージェントをローカルで動かしているからといって自動的に安全になるわけではありません。インターネットに接続したり他のシステムとやり取りしたりすれば、影響を受ける可能性があります。ローカルでの管理は一部のリスクを低減しますが、完全な解決にはなりません。

露出したエージェントが攻撃対象になる理由

一度露出すると、エージェントは攻撃者が調べ、テストし、操作できる対象になります。彼らは細工した入力を与えたり、行動を引き起こしたり、時間をかけて挙動を学習しようとするかもしれません。

エージェントが現実に行動できるため、悪用は従来のハッキングのように見えないことがあります。挙動の誘導、データの抽出、意図しないシステム変更などが、従来のソフトウェア脆弱性を悪用しなくても発生し得るのです。

AI エージェントのセキュリティにおける「致命的三重奏」とは?

「致命的三重奏」は、AI エージェントに対して深刻なセキュリティリスクを生む三つの条件を表す言葉です。

深刻な攻撃を可能にする三つの条件

- 第一の条件は、ファイルや認証情報、内部情報などの機密データへのアクセスです。

- 第二は、エージェントが完全に検証できない信頼できない入力を取り込むことです。

- 第三は、リクエスト送信、システム変更、コマンド実行など外部で行動を起こせる能力です。

これらは個別には管理可能かもしれませんが、三つが揃うと危険性は格段に高まります。信頼できない入力を読み取り、それに基づいて行動できるエージェントは明確な操作経路を提供してしまいます。エージェントに許可する行動を厳しく制御することが不可欠です。

一般のユーザーは今日から AI エージェントを使うべきですか?

多くの人にとって、AI エージェントはまだ実験的なツールです。適切に管理されれば有用ですが、同時にわかりにくい新たなリスクも生みます。

エージェントを使うことが合理的な場合

エージェントは、コントロールが効きリスクが低い状況で意味を成します。別のデバイスで実験するなど、分離した環境で試すのが一例です。ファイル整理やワークフローのテストなど、機密性の低い作業だけを任せる人もいます。

たとえば、旅行の行程を作成する目的でエージェントを使う場合、必要な情報にアクセスさせつつ、人と直接連絡を取ったり重大な操作を行えないように制限できます。

設定を管理でき、ミスが重大な影響を及ぼさないと確信できるなら、エージェントは学習ツールとして有益です。重要なのは対象を小さくし、アクセスを厳密に限定することです。

エージェントを使うべきでない場合

機密データや重要なアカウントにアクセスを与える場合、AI エージェントは不向きです。権限や外部入力の危険性を理解せずに運用することは、リスクを急速に高めます。

また、利用しないという選択も合理的です。利便性がセキュリティや安心を犠牲にする場合、現時点でエージェントを動かさないという判断は十分に妥当です。

AI エージェントを使う際に最低限必要な防護策は何ですか?

基本的な防護策はリスクを低減し、ミスが深刻な問題になるのを防ぎます。

Kaspersky のソフトウェアは、不審な動作をフラグ付けしたり、アカウントの侵害から守ったりする追加の保護層を提供できます。弊社のプラン はマルウェアやウイルスからランサムウェア、スパイアプリまで幅広くブロックします。

最も重要な安全対策

隔離が鍵です。可能であればエージェントは別のデバイスやアカウント上で実行し、重要なデータやシステムに影響を与えないようにしてください。エージェントが本当に必要とする最小限の権限だけを与え、デフォルトでフルシステムやアカウントアクセスを許可しないことを推奨します。

承認プロセスも重要です。機密性の高い操作の前に確認を求めることで、代金支払いなどの意図しない操作を防げます。こうしたシンプルな制御は複雑さを増やさずに大きな効果をもたらします。

AI エージェントは消費者向け AI の将来に何を意味するか?

AI エージェントは、単に支援するだけでなく実際に行動する道を示しています。しかし、この変化には消費者がこれから対処していくべきトレードオフが伴います。

この時点が示すエージェントの成熟度について

AI エージェントは強力ですが未成熟です。タスクの自動化は可能でも、判断やセキュリティの面ではまだ課題があります。これは将来的に改善され、安全で信頼できるものになる余地がある一方で、現時点では期待を現実的に持つ必要があることを意味します。

エージェントは今後の方向性を示しますが、日常的に広く使われるには、初めから安全性を重視して設計されたより良い保護機能やツールが必要になります。

関連記事:

- ChatGPT はサイバーセキュリティの懸念や潜在的リスクにどう対処しているか?

- 今日のデジタル環境における AI サイバー犯罪のリスクとは?

- AI と機械学習はサイバーセキュリティ対策をどう強化するか?

- ディープフェイク技術の今日的な危険性とは?

おすすめ製品:

よくある質問

OpenClaw は無料でダウンロードできますか?

OpenClaw は GitHub で自由にダウンロードできます。オープンソースソフトウェアであり、改変や再配布の余地があります。

OpenClaw のセットアップは簡単ですか?

短時間でボットを動かせるチュートリアルはありますが、洗練された構成には時間と専門知識が必要です。不適切に設定されたソフトウェアを運用することは、いっそうリスクを高めます。